“Oh it’s a tap tap world we live in / making up lives cause we’re driven / to be more than just the norm / in our imaginations reborn”

— 80 Hundred Miles feat. Moly Cat, Tap Tap World (2024)

Scrollare. Il vizio che non sapeva il suo nome — finché un tribunale gliel’ha detto

— “Cosa guardi di bello?”

— “Boh.”

Fine della conversazione.

E anche questa variante, per chi vuole la trama completa:

— “Ah, bello quello sketch! L’ho visto anche io ieri!”

— “Quale?”

— “Quello che hai appena visto!”

— “Ah… no, non stavo guardando…”

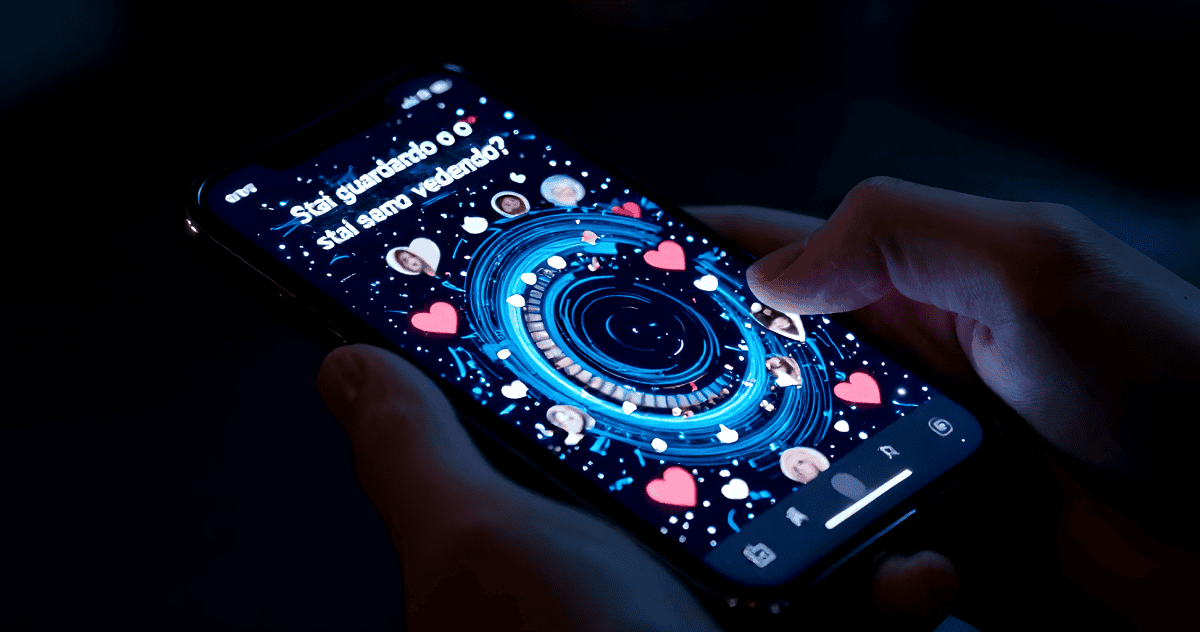

Stava vedendo, ma non stava guardando. Due azioni che sembrano la stessa cosa e non lo sono per niente. Vedere è passivo — è quello che succede agli occhi quando la mente è andata a fare altro. Guardare richiede presenza. Richiede di esserci davvero.

Questa, in fondo, è la definizione più onesta che abbia mai sentito di scrollare.

Scrollare: una parola con una storia importante!

Per secoli, in italiano, “scrollare” aveva un significato molto specifico e quasi esclusivamente maschile. Lo si faceva in bagno, in piedi davanti alla tazza, come gesto conclusivo. Un movimento meccanico, automatico, privo di qualsiasi implicazione filosofica.

Poi è arrivato lo smartphone.

La parola ha cambiato corpo senza cambiare anima. L’automatismo è rimasto. La meccanicità è rimasta. Persino la location, a volte, è rimasta. Ma lo scarico non è più acqua: è attenzione. È tempo. È quella cosa vaga che chiamiamo “presenza mentale” e che cediamo senza accorgercene, un dito alla volta.

Scrollare è diventato il vizio che era la sigaretta per i tabagisti incalliti degli anni Settanta: quelli che ne accendevano una dietro l’altra senza nemmeno ricordare di averla accesa. Quella dipendenza aveva un nome — nicotina — e degli ingredienti segreti che le aziende del tabacco aggiungevano apposta per renderla più efficace e più difficile da mollare.

Oggi quegli ingredienti segreti si chiamano algoritmi.

Lo scroll infinito, quella funzionalità per cui il feed non finisce mai, non è stata creata per caso. È stata inventata da un programmatore di nome Aza Raskin, che in seguito ha pubblicamente dichiarato di essersene pentito. Nessun fine corsa. Nessun momento in cui lo schermo ti dice “ok, per oggi basta”. Solo il vuoto che continua verso il basso, aspettando che tu ci cada dentro.

Il confessore che nessuno ha ascoltato

C’è un momento preciso in cui qualcuno dall’interno ha detto la verità ad alta voce. Era il 2017. Si chiamava Sean Parker, era stato il primo presidente di Facebook — quello interpretato da Justin Timberlake nel film, per capirci.

In un’intervista aveva scelto di essere scomodo: il processo creativo dietro queste app era, fin dall’inizio, “come posso consumare il più possibile del tuo tempo e della tua attenzione cosciente?”. La risposta che si erano dati era semplice: darti ogni tanto una piccola dose di dopamina. Un like. Un commento. Una notifica. Abbastanza da farti restare, troppo poco da farti sentire soddisfatto. Un loop di validazione sociale calibrato sulle vulnerabilità della psicologia umana.

Poi aveva aggiunto, tra il serio e il faceto: “Credo che adesso Zuckerberg bloccherà il mio account.”

Ci avevano riso sopra. Era il 2017. Il mondo aveva fatto sostanzialmente niente.

Il Processo. La Sentenza. La Storia.

Il 25 marzo 2026 è una data che potrebbe diventare un prima e un dopo.

Una giuria della Corte Suprema di Los Angeles, dopo nove giorni di deliberazioni e un processo durato un mese intero, ha emesso il proprio verdetto: Meta Platforms e Alphabet (la società madre di YouTube) sono state ritenute responsabili di aver progettato deliberatamente piattaforme che creano dipendenza, e negligenti sulle misure di sicurezza per i minori.

La denuncia era partita da una ragazza di vent’anni, identificata come Kaley G.M., che ha raccontato come l’uso di Instagram e YouTube durante l’infanzia l’abbia portata a sviluppare depressione e pensieri suicidi. Il risarcimento stabilito dalla giuria è di 3 milioni di dollari, di cui il 70% a carico di Meta e il 30% di YouTube. Non è una cifra enorme per aziende che fatturano centinaia di miliardi. Ma non è questo il punto.

Il punto è il principio.

Per la prima volta nella storia, una giuria ha stabilito che funzionalità come lo scrolling infinito e i consigli algoritmici che inducono dipendenza non sono semplici scelte di design: sono scelte consapevoli e dannose, soprattutto per gli adolescenti e i bambini. E che le aziende lo sapevano.

Mark Zuckerberg ha testimoniato in aula. TikTok e Snap, che erano co-imputati, hanno scelto di patteggiare prima che iniziasse il dibattimento.

A poche ore di distanza dalla sentenza californiana, un tribunale di Santa Fe, New Mexico, ha emesso una condanna separata contro Meta, stabilendo che l’azienda ha violato la legge statale sulle pratiche sleali, ha anteposto il profitto alla sicurezza dei bambini e ha occultato i potenziali impatti sulla salute mentale dei minori.

Due verdetti. Stesso imputato. Stesso copione: profitto prima di tutto.

Il momento “Big Tobacco”

Citizen.org ha definito questi verdetti “il momento Big Tobacco dei social media”. È una metafora precisa — vale la pena svilupparla.

Per decenni, le grandi aziende del tabacco hanno venduto sigarette sapendo dei danni, minimizzando le prove, finanziando controricerche. Il punto di svolta è arrivato quando i tribunali hanno iniziato a dire che il prodotto era progettato per nuocere — e che chi lo produceva lo sapeva benissimo.

Meta sapeva. Le ricerche interne di Facebook — emerse con la crisi di Frances Haugen nel 2021 — mostravano che l’azienda era consapevole dei danni di Instagram sulle adolescenti, in particolare sull’immagine corporea, e aveva scelto deliberatamente di non agire. Parker lo aveva detto nel 2017: quello non era un effetto collaterale. Era il modello di business.

La differenza con il Big Tobacco? Le sigarette almeno avevano il pacchetto. Il feed è infinito, non finisce mai e — dettaglio fondamentale — non costa niente. La dipendenza è il prezzo che non compare sulla ricevuta.

I Dati che Non Piacciono a Nessuno

La difesa di Meta e Google si è basata su un argomento classico: “Il problema non sono le nostre piattaforme, ma i problemi familiari, il bullismo reale, la fragilità preesistente dei soggetti.” È la versione tech di “la pistola non uccide, uccide chi la usa”.

Peccato che i dati dicano altro.

Uno studio condotto dalla UCSF (Università della California, San Francisco) ha seguito circa 12.000 bambini tra i 9 e i 13 anni per tre anni. Risultato: il tempo medio giornaliero sui social è passato da 7 a 73 minuti, e nello stesso periodo i sintomi depressivi sono aumentati del 35%. I dati non mostravano il contrario, cioè che la depressione preesistente spingesse i ragazzi a usare di più le piattaforme. Era il social ad arrivare prima, la depressione dopo.

In Italia, gli accessi in pronto soccorso per ideazione suicidaria tra gli adolescenti sono aumentati del 147%, seguiti da depressione (+115%) e disturbi del comportamento alimentare (+78,4%). Sono numeri che fanno male solo a leggerli.

Uno studio pubblicato su Scientific Reports e condotto dall’Università Miguel Hernández in Spagna ha precisato il meccanismo: il rischio non dipende semplicemente dal quanto si usano i social, ma dal come. Il fattore critico è l’uso problematico, ovvero quando il ragazzo perde il controllo del proprio comportamento online e sente un bisogno compulsivo di restare connesso. E chi è già emotivamente fragile è esposto in modo esponenzialmente maggiore.

In sintesi: gli algoritmi non colpiscono tutti allo stesso modo. Trovano le falle. Ci si infilano dentro. E premono.

Le Implicazioni: un Effetto Valanga

Questo processo non era solo la storia di Kaley. Era un bellwether case, un processo-pilota destinato a stabilire il tono per una valanga di cause simili in tutta America.

Il Social Media Victims Law Center ha già in mano più di 1.000 casi simili. I procuratori generali di 40 stati americani hanno intentato cause contro Meta e altre piattaforme. Il verdetto californiano è, nei fatti, il colpo di pistola che dà il via a una corsa che potrebbe ridisegnare completamente le regole del gioco.

Le aziende, ovviamente, ricorreranno in appello. “Contestiamo rispettosamente questa sentenza”, ha dichiarato un portavoce di Meta. Google ha aggiunto che YouTube “non è un social media ma una piattaforma di streaming costruita responsabilmente”. Interessante ridefinizione del prodotto, considerata la presenza del feed di raccomandazioni algoritmiche e dei commenti.

Ma qualcosa si è rotto. O meglio: si è finalmente mostrato per quello che è.

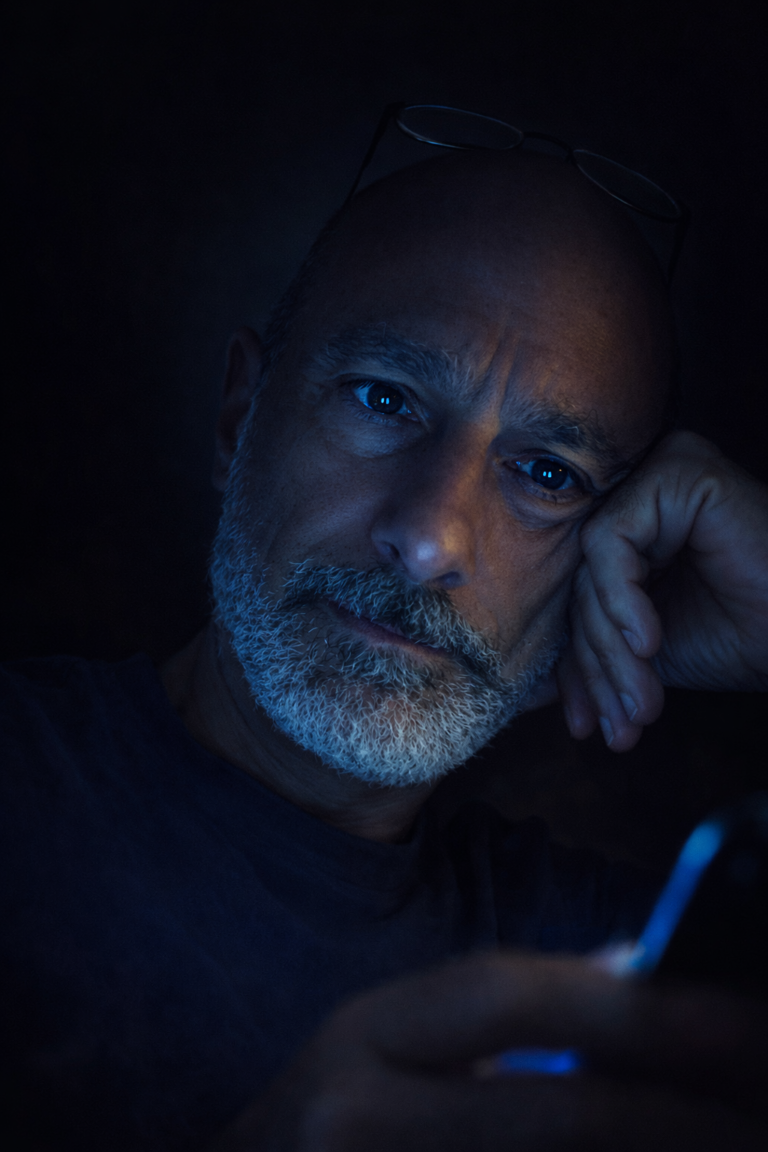

E noi, adulti “consapevoli”?

Facile fare il processo a Meta quando si parla di bambini di sei anni.

Meno facile rispondere onestamente a questa domanda: quante volte oggi hai aperto un social perché non volevi sentire qualcosa?

Lo scroll come anti-meditazione. Svuota la testa — tecnicamente. La riempie di rumore di fondo. Di frammenti. Di indignazioni a scadenza. Di sketch che il giorno dopo non ricordi. Di vite altrui che sorridono perché sono state selezionate per sorridere.

C’è una narrazione comoda che ci raccontiamo: “Io i social li uso con consapevolezza.” “Io so quando smettere.” Parker, che ha aiutato a costruire il sistema, direbbe che questo è esattamente quello che il sistema vuole che tu pensi. La dipendenza più efficace è quella che non si riconosce come dipendenza.

Tap Tap World lo dice nel bridge con una domanda senza risposta: “Will we ever meet in true light / or stay hidden in this app’s night?” Incontreremo mai davvero qualcuno al di là dello schermo, o resteremo tutti nascosti nella notte di questa app? È una domanda retorica. Ma ha il fastidioso vizio di tornare in mente quando sei lì, a scorrere facce e profili alle undici di sera.

La buona notizia — e sì, c’è — è che quando il trucco viene nominato ad alta voce, smette di funzionare allo stesso modo. Un tribunale lo ha appena fatto, a voce abbastanza alta da arrivare fino a qui.

Quello che cambia adesso

Quello che cambia dopo queste sentenze è più sottile del conto che Meta dovrà pagare. È l’idea che il design di un’app possa essere trattato come un difetto di prodotto. Come la mancanza di un avvertimento su un farmaco. Come un’auto venduta senza cinture di sicurezza.

Se questo principio regge nei gradi di giudizio successivi — e ci vorrà tempo, ci saranno appelli, ci saranno battaglie costose e lunghe — il modo in cui queste piattaforme sono progettate dovrà cambiare. Per legge, prima ancora che per etica. E quando le leggi cambiano i prodotti, i prodotti cambiano le abitudini.

È andata così con le sigarette. Lentamente, goffamente, tra mille resistenze. Ma è andata.

Nel frattempo, c’è una domanda che vale la pena portarsi dietro. Te la pone un ritornello scritto prima che questa storia finisse in tribunale.

Oh it’s a tap tap world we live in.

Stai guardando, o stai solo vedendo?

P.S. — Se hai trovato questo post su un feed mentre scrollavi e sei arrivato fino in fondo: complimenti. Hai appena dimostrato che la differenza tra vedere e guardare esiste ancora. Si chiama scelta. E non ha ancora bisogno di un algoritmo per funzionare.

P.P.S. — Il brano da cui nasce tutto: Tap Tap World — 80 Hundred Miles feat. Moly Cat, su Spotify.

Creativo digitale, musicista e narratore. Esploro le intersezioni tra umanità e tecnologia, raccontando storie di AI, musica e vita vissuta. Benvenuti nel mio disordine organizzato.”